最终,还是回归文字

“从前的日色变得慢,车,马,邮件都慢”(木心, 2013, p.115)。

生为八零后,我们都经历过十多年没有互联网的“慢”日子。

从前,无法见面的一对一沟通主要靠书信。要么长篇舒胸臆,要么简短写个字条。会谨慎写下对方的称谓,会郑重签下自己的姓名,会绞尽脑汁地使用标点符号,或画个简笔画来巧妙地表达情绪。

从前,无法当面的一对多宣讲主要靠文章。想要群发给多个人阅读,得掂量掂量自己的钱包。如果复印的成本过高,干脆多抄写几遍,把写得最工整、最没有涂改痕迹的版本发给最重要的人,而字迹最潦草的最后一版,必定属于最无关紧要的人。

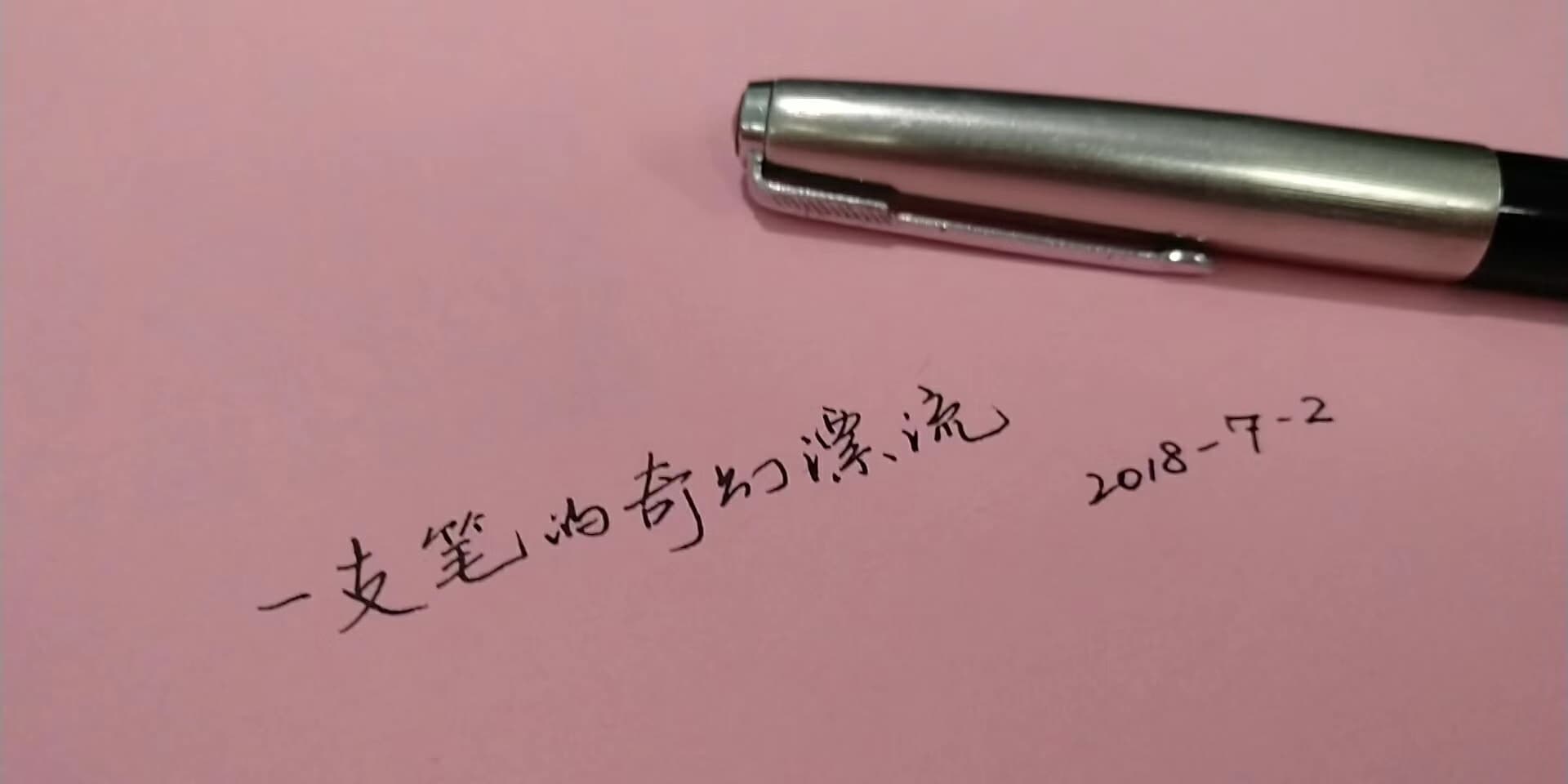

大学期间,为了随时写下文字,我曾经随身携带着一支钢笔。把笔别在上衣口袋这装扮太老土了,所以就把它放在背包里。但为了避免钢笔漏水的风险,笔放在背包里的方向是有讲究的,得保证笔尖的角度向上,还得固定在背包里避免晃动,如果遇上需要快走或快跑几步的时候,双手一定会下意识紧紧按住背包和里面的笔,生怕因为震动泼洒了墨水。

但即便再过小心,也难免有几次真的漏了钢笔水出来,这时,珍藏在背包侧面口袋的小包纸巾就派上用场了。那纸巾通常是粉白色的“心相印”三层纸巾,更有可能是长宽比更大的、蓝色和白色包装的、价格更为优惠的“维达”牌双层纸巾。纸巾从小包装袋中抽出来,接下来一定是先把三层或两层的纸巾揭成一层层,一次只取薄如蝉翼的一层,节省着使用。擦拭时难免懊悔,懊悔刚刚不该那么剧烈地从台阶上跳下来,更懊悔此刻又白白浪费了一层纸巾。

曾经,总能找到大块的时间安静地写下一些文字,即便只给一个或两个人看,也从来不觉得这样的写作效率太低,更不会因为缺少了朋友和陌生人的点赞而产生巨大的失落感……哦对,那个时候“点赞”这个东西还没诞生呢!

后来二十多年间,互联网带来的一切,大家都亲历过了。

在这二十多年期间,我们每个人都创造了比当年更大的信息熵。便利的网络让人与人之间的交互变得更为频繁,但短促。

曾有几年,无数文字作者们为了写出“10w+”阅读量的文章,纷纷研究如何能写出“标题党”或博眼球的行文方式,成功者被人追捧甚至因此盆满钵满。

而普通人逐渐淹没在朋友圈或各种平台的信息汪洋里,日常的碎碎念和对美好生活的分享,大多建立在潜意识中对所获点赞和评论的期待上。文字,越来越短。思想,越来越支离破碎。写不出来的内容,用图片代替;图片体现不足的方面,用滤镜加强。

现在好了,生成型AI(Generative AI)横空出世,连日常的碎碎念,许多人也已经无需过多思考了。

许多人对生成型AI的原理有误解,或者根本就不了解,以为此AI真的是普遍意义上的“智能”,实则不然。以下列举一些最近的研究论文的发现吧。

在AI训练中不加区分地使用模型生成的内容会导致生成的模型出现不可逆的缺陷,其中原始内容分布的尾部会消失,这种效应称为Model Collapse “模型崩溃” (Shumailov et al., 2024)。换句话说,现有的AI模型在训练过程中可能会逐渐丧失对原始数据分布的理解,导致输出内容的多样性和质量下降,最终可能生成无意义的内容。

此外在科学研究领域应用生成型AI,“……只能进行渐进式发现,而无法像人类一样从零开始实现基础性发现……仅擅长于涉及领域知识已知表示或访问人类科学家知识空间的发现任务。此外,它还过于自信地幻想自己能够完全成功发现。” (Ding & Li, 2025, para.1)。

更多的研究不再枚举。去年我跟儿子系统地学习了NVIDIA的生成型AI课程 (NVIDIA Deep Learning Institute, n.d.),了解了什么是“生成型AI”之后,我意识到媒体对于生成型AI的宣传就跟上面引用的那段话一样,大家“过于自信地幻想”AI可以在很多领域代替人类了,至少在文字的情感和温度上,作者自己永远能体会得到不同。

因此,我预测在未来一些年里,跟过去几年相比,文字作者反而会变得更为珍贵。

而匆匆忙忙的我们啊,如果有机会慢下来,回想从前慢的那些日子,最终,还是回归文字,不一定非要拾起那支可能漏墨的钢笔,而是,重新安静下来,给自己一个大块的时间,把键盘敲击起来。

References:

Ding, A. W., & Li, S. (2025). Generative AI lacks the human creativity to achieve scientific discovery from scratch. Scientific Reports, 15, Article 9587. https://doi.org/10.1038/s41598-025-93794-9

NVIDIA Deep Learning Institute. (n.d.). Fundamentals of Deep Learning for Multi-GPUs [Online course]. NVIDIA Learn. https://learn.nvidia.com/courses/course-detail?course_id=course-v1:DLI+S-FX-07+V1

Shumailov, I., Crowley, E. J., Houlsby, N., & Fowl, L. (2024). The curse of recursion: Training on generated data makes models forget. Nature, 627(7997), 824–830. https://doi.org/10.1038/s41586-024-07566-y

木心.(2013).从前慢. 载于 云雀叫了一整天. 浙江文艺出版社.